Очень не люблю долгие вступления. Да, и пришли вы сюда не за этим. Давайте сразу к делу: сегодня мы рассмотрим вопрос технического аудита сайта с помощью программы Screaming Frog SEO.

Как пользоваться Screaming Frog SEO Spider

Сама программа распространяется бесплатно, хоть и имеется платная версия — функционал при этом мало ограничен, что позволяет провести полноценный технический аудит сайта. Но прежде чем приступить к работе, необходимо немного ознакомится с настройками в Screaming Frog. Давайте разберем самые важные. Заходим Configuration > Spider и далее по вкладкам.

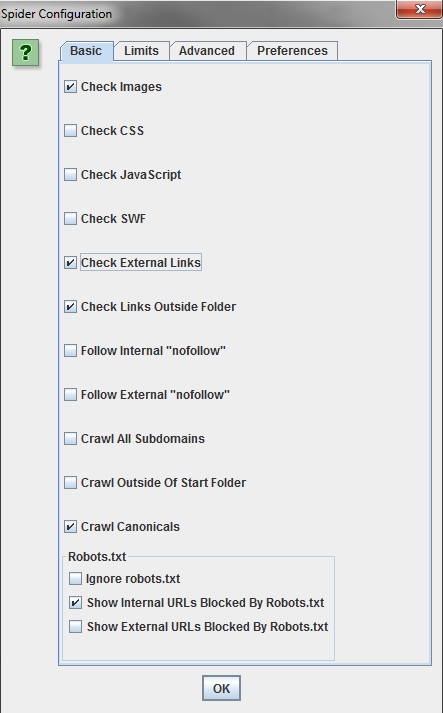

Basic

Чтобы ускорить анализ сайта, можно исключить из парсинга CSS стили, JavaScript, SWF (это проприетарный формат для флеш-анимации, векторной графики, видео и аудио в инете).

Limits

Тут нас интересует только Limit Search Depth — это настройка ограничения по вложенности страницы. Например, страницы больших сайтов с огромным количеством товаров в каталоге обычно имеют глубокую вложенность по url. Ставим подходящее нам ограничение и заметно экономим время.

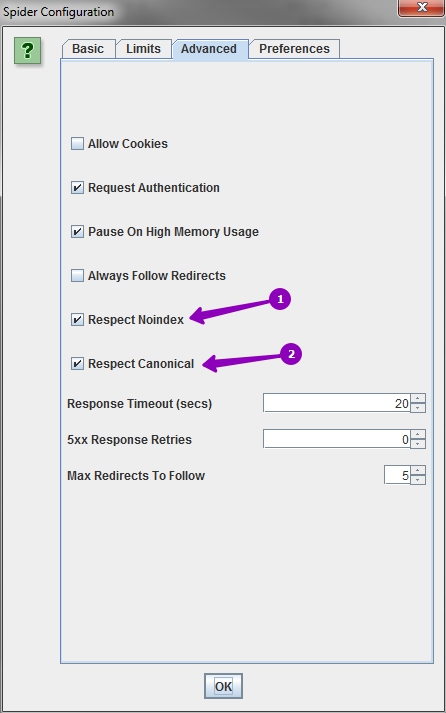

Advanced

Cтавим галочки так, как показано на скриншоте. Тем самым будем изучать только ту информацию, которую видят поисковые роботы.

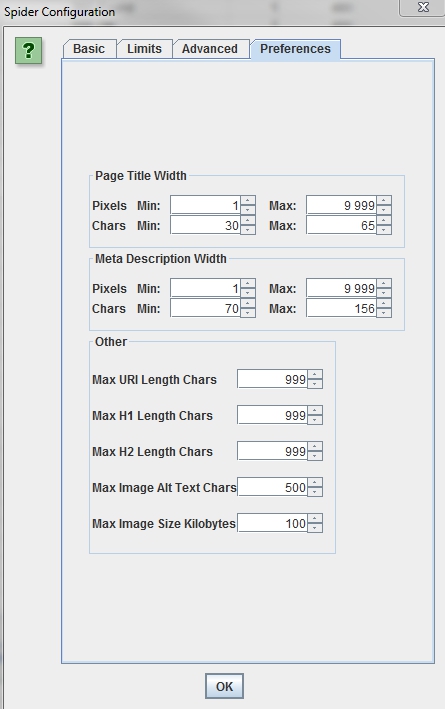

Preferences

Screaming SEO Frog предлагает указать пожелания по размеру метатегов, урла, заголовков h1/h2, длине атрибута alt и размера изображения. Можно указать большие значения, чтобы не упускать ничего.

Бывает, что необходимо проверить только определенные разделы или один, а может и наоборот — все, кроме некоторых или кроме одного. Чтобы проверить конкретные разделы, заходим в Configuration > Include, где указываем раздел. Если нужно исключить: Configuration > Exclude и аналагично указываем исключаемые разделы.

Если у вас новый сайт, который еще не готов к открытию (и админки как таковой еще нет), а провести технический аудит нужно — в SEO Screamig Frog можно указать логин и пароль. Чтобы не указывать админский доступ, можно создать ограниченный — гостевой

Если сайт закрыт в robots. txt, в настройках (вкладка Basic) необходимо включить опцию игнорирования данного файла.

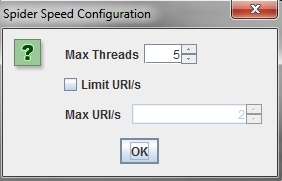

Скорость парсинга

Еще одна основная настройка SEO Frog. При запуске парсинга в самом низу указывается средняя скорость и текущая. Если сайт не выдерживает большой скорости, то лучше в настройках указать определенное значение.

Все настройки готовы и теперь можно приступить к старту парсинга сайта. В верхней части SEO Frog указываем сайт, нажимаем Start и ждем. Время ожидания зависит от размера сайта, в основном это от 5 до 25 минут.

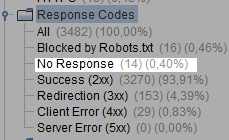

Проверим качество парсинга

Переходим в правую часть программы и ищем Response Codes. Если в строке No Response слишком большое значение, то необходимо вернуться в настройки и понизить скорость парсинга. Тише едешь — дальше будешь.

Пример аудита сайта

Перед тем как приступить к работе, хочется дать небольшой совет. Каждую страницу из SEO Spider Frog можно выгружать и затем форматировать на свое усмотрение в Excel. В большинстве случаев это очень удобно: можно фильтровать и откидывать ненужную информацию. В данной статье мы разберем программу и информацию без выгрузки файлов, но суть от этого не меняется.

Итак, давайте из всей отчетной информации выберем самую важную.

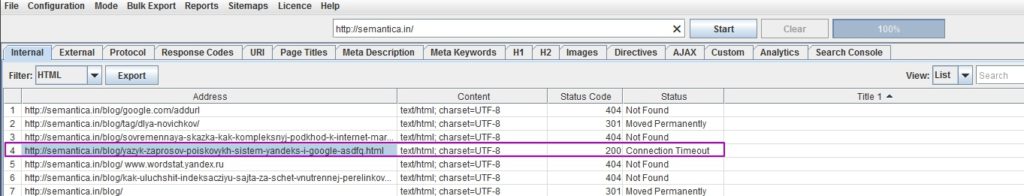

Проверка кодировки страниц

Выбираем вкладку Internal и в фильтре HTLM и глазами пробегаемся по столбцу Content. Везде должна быть кодировка UTF-8. Если она отличается, то следует посмотреть на код ответа сервера в соседней колонке. Например, если есть 301 редирект, значит все ок.

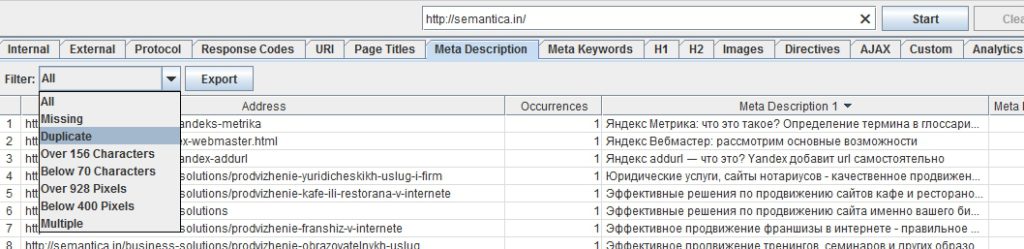

Проверяем мета-теги с помощью SEO Spider Screaming Frog

Данный пункт имеет большое значение. Сперва стоит проверить на всех ли страницах есть h1, title и description. Для этого находим нужный столбец, фильтруем его двойным нажатием на заголовок и смотрим результат. На скриншоте видно, что все страницы без мета-тега Title имеют код ответа сервера 404 или 301 редирект. За исключением одной страницы, но это ошибка при парсинге, т.к. если зайти на нее можно убедиться, что тайтл присутствует. Ошибки программа выдает крайне редко и 1 на 500 страниц не так и страшно, если ошибок много, то следует уменьшить в настройках скорость парсинга и перезапустить процесс.

Так можно проверить title, description, заголовки h1 и h2. Помимо наличия в соседней колонке указывается длина в символах и ширина в пикселях. Поэтому необходимо после проверки наличия мета-тегов проверить и их длину.

Также следует проверить одинаковые description, title и h1. Сделать это можно вручную: пробежать глазами по списку (если страниц немного) или во вкладке отфильтровать должным образом.

После проверки необходимо заполнить все мета-теги и сделать их уникальными в пределах ресурса. Данная процедура имеет немалое значение в SEO оптимизации сайта и весьма положительно влияет на место в выдаче.

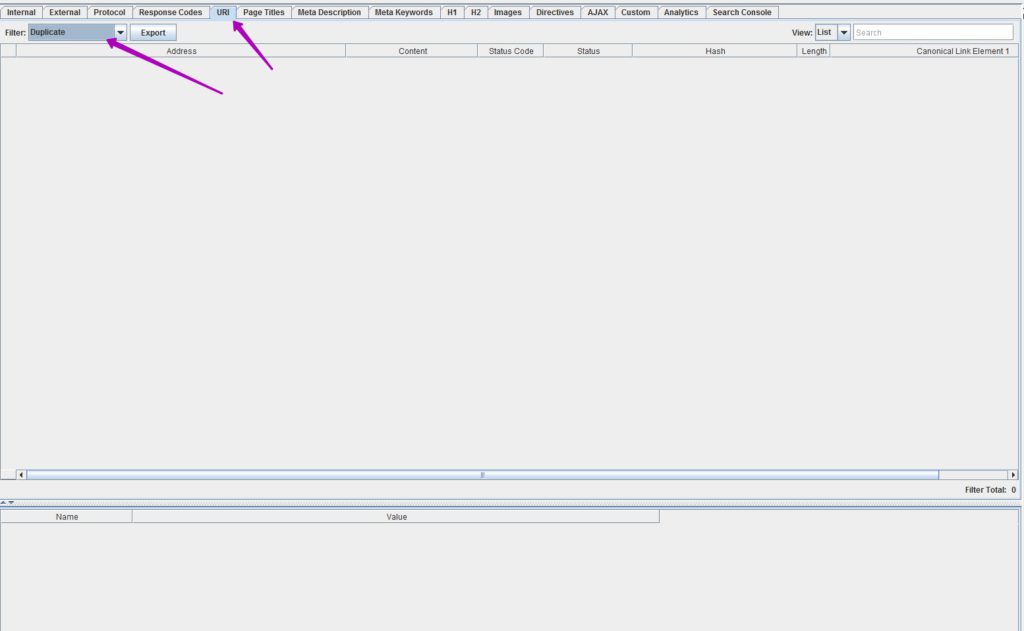

Теперь перейдем к вопросу — как найти дубли страниц на сайте. Переходим во вкладку URL, в фильтре выбираем дубликат. В идеале получаем такой результат.

Если дубли все же есть, необходимо избавиться от них. Сделать это можно двумя способами: удалить все дубли или закрыть от индексации поисковыми системами в файле robots.txt.

Также стоит обратить внимание на размеры и время загрузки страниц сайта. Возвращаемся во вкладку Internal и ищем колонки Size и Response Time. Размер кода страницы не должен превышать 200 килобайт, если видим больше — заходим на страницу и анализируем проблему. Скорость загрузки не должна превышать 5−6 секунд. Обычно «тяжелые» страницы прогружаются именно на этом временном пороге, т. е. больше уже плохо. Опять же заходим, анализируем, исправляем.

Оптимизация изображений

Оптимизация картинок также имеет свое значение в комплексном аудите сайта. Например, Яндекс охотнее возьмет картинку в соответствующую выдачу, а это дополнительный трафик и + в карму от поисковой системы. Скриминг фрог и в этом вопросе может нам помочь. Переходим на вкладку Images, в фильтре выбираем Over 100 kb, ищем объемные картинки и затем Missing Alt Text. Конечно, настроек изображений много, но это основные две, которые рекомендуется соблюдать.

Анализ перелинковки

Не будем подробно разбирать правила перелинковки, просто расскажу два важных правила:

- Важные для продвижения страницы должны быть как можно ближе к главной.

- Должны иметь как можно больше входящих ссылок и меньше исходящих, чтобы у страницы был хороший внутри-ссылочный вес.

Во вкладке Internal ищем inlinks и outlinks, сортируем по значению. Желательно найти все важные и продвигаемые разделы в списке, для этого можно воспользоваться поиском. Значения входящих и исходящих ссылок у каждого сайта будут разные. Поэтому стоит отталкиваться от общего количества страниц и средне-ссылочной массы каждой из них.

Поиск пустых страниц

Там же (во вкладке Internal) выбираем в фильтр HTML и переходим к столбцу Word Count. Отфильтровываем по значению и смотрим, где значение равно нулю либо подозрительно маленькое. Главное, сразу отбросить страницы с кодом 404 и 301 редиректами. Пустые страницы следует наполнить контентом (если они нужны). В противном случае закройте их от индексации или избавьтесь от них вовсе.

Поиск проблемных URL

В SEO Spider Frog переходим во вкладку URL и смотрим по разным параметрам фильтра, но прежде давайте разберемся «who is who».

- Non ASCII Characters — это урлы, которые имеют символы, не входящие в схему кодировки ASCII символов. Исправляем, т.к. в будущем возникнут проблемы с ссылками на такие страницы.

- Underscores — урлы, в которых используется нижнее подчеркивание. Правилом хорошего тона считается написание через дефис. Это не критично, но исправить желательно.

- Duplicate — самый важный фильтр, ради которого мы заходим в этот раздел. Видим все дублирующие страницы на сайте. Необходимо найти причину образования дублей и как можно быстрее решить проблему.

- Dynamic — показывает список url, которые содержат символы типа «&», «!» и «?». Задача не критичная, но проанализировать стоит.

- Over 115 characters — покажет нам длинные url. К данному пункту стоит присмотреться. Т.к. есть любители поспамить ключами в урлах, за что часто можно поплатиться санкциями за переспам.

В любых операциях с URL не стоит забывать про 301 редирект.

Анализ внешних ссылок с сайта с помощью Frog Sreaming

Вкладка External позволяет просмотреть список всех исходящих внешних ссылок. Желательно провести детальный анализ и затем периодически проверять их количество и качество. Переходим на вкладку External и фильтруем колонку Status Code по значению. Нас интересуют нерабочие ссылки. Просматриваем, меняем их на своем сайте или удаляем вовсе. Внизу во вкладке In Links можно увидеть список страниц, которые содержат ссылку на определенный сайт.

Далее желательно просмотреть все ссылки, проверить все ли ваши. Бывают случаи, когда кто-то получает доступ к вашему сайту и шпионским образом проставляет ссылки. Случай редкий, но проверить надо.

Экспертное мнение

С каждым днем факторов ранжирования поисковыми системами становиться все больше. Попасть в заветный ТОП выдачи все сложнее, а тут еще и конкуренты выкатывают свои сайты. Необходимо встать на голову (а то и на две) выше остальных. Для этого SEO специалисты делают технический аудит сайта и детально анализируют каждый пункт.

Если вы не сеошник, то решение провести самостоятельный технический аудит сайта похвально. Такая программа как Screaming Frog Spider SEO может очень помочь вам в этом деле, но для полной оптимизации сайта этого все же недостаточно. Существует множество сервисов, которые помогают проанализировать проблемы, но, на мой взгляд, данная программа имеет самый обширный арсенал возможностей. И помните главное правило — лучше делать долго, но качественно, чем быстро и почти никак.